主要AIデータセットから児童性虐待資料が発見される。研究者は驚いていない。

LAION-5Bデータセットは、数多くのAIモデルの基礎となっている。研究者たちは長い間、膨大なトレーニングデータセットの監査が不十分であることを警告してきた。

画像生成AIの訓練に使用される最大のデータセットから、性的虐待を受けた子どもの画像が1000枚以上も発見された。

このデータセットは、Stable Diffusionのような生成AIシステムで使用される膨大な画像データセットの背後にある非営利団体LAIONによって作成された。スタンフォード大学の研究者からの報告を受け、404 Mediaは、LAIONがLAION-5Bと呼ばれるデータセットに児童性的虐待資料(CSAM)が含まれていることを確認し、オンラインチャンネルから削除したと報じた。HuggingFace社のAI・データ倫理研究者で、Birhane氏と論文を共著したSasha Luccioni氏は、「悲しいことですが、本当に驚くべきことではありません」とMotherboardに語った。「ほとんどすべての画像生成モデルは、何らかのバージョンの[LAION]を使用していました。そして、すでに訓練されたものを削除することはできません"

ルッチョーニによれば、問題はこれらの膨大なデータが使用される前に適切に分析されていないことであり、データセットの規模が不要なものをフィルタリングすることを極めて困難にしている。言い換えれば、たとえLAIONが発見後に特定の不要な素材を取り除くことに成功したとしても、データが膨大であるため、それをすべて取り除いたことを確認するのは事実上不可能だということだ。

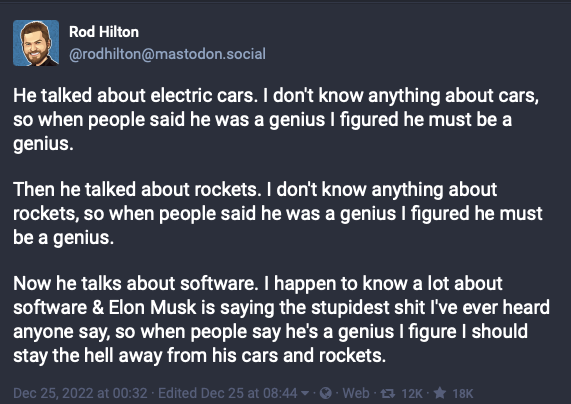

「誰もデータの仕事をしたがらない。」「誰もデータの仕事を評価しない。みんな、モデルをブルブルさせたいだけなんだ。」("Gorrr "とは、仮想の貨幣印刷機を指すミームである)。

AI倫理の研究者たちは、インターネットから引き出された人種差別的・性差別的なテキストや画像を含むAIモデルやデータセットの危険性について何年も前から警告を発してきた。こうしたバイアスが、医療、住宅、警察などの分野で差別を複製し増幅する自動システムをどのように生み出すかを実証する研究が相次いでいる。LAIONデータセットは、この「ガベージイン、ガベージアウト」ダイナミクスのもう一つの例であり、露骨な、違法な、あるいは攻撃的な素材で満たされたデータセットがAIのパイプラインに定着し、その結果、同じ問題やバイアスをすべて受け継いだ製品やソフトウェアが生まれる。

このような弊害は、有害な出力や望ましくない出力を生成しないよう、事後的にシステムを微調整することで軽減することができる。しかし、ルッチョーニのような研究者は、このような技術的な微調整は、実際には問題の根本原因に対処していないと警告する。

「AIにおけるデータセットの集め方、使い方を根本的に考え直す必要があると思います」とルッチョーニは言う。「そうでなければ、根本的な問題を解決しない技術的な修正に過ぎない。」